Chatkontrolle

🇫🇷 Französisch: Traduction du dossier Chat Control 2.0

🇸🇪 Schwedisch: Chat Control 2.0

🇳🇱 Niederländisch: Chatcontrole

Inhalt der Seite:

- Die Abschaffung des Digitalen Briefgeheimnisses und das Ende anonymer Kommunikation

- Hilf jetzt mit die Chatkontrolle 1.0 zu stoppen!

- Das geplante Gesetz zur Chatkontrolle 2.0

- Was hat das Ganze mit dir zu tun?

- Mythen entlarvt

- Weiterführende Informationen & Argumente gegen die Chatkontrolle

- Alternativen zur Chatkontrolle

- Dokumente zur Chatkontrolle 2.0

- Dokumente zur Chatkontrolle 1.0

- Kritische Stellungnahmen und Hintergrundartikel

Die Abschaffung des Digitalen Briefgeheimnisses und das Ende anonymer Kommunikation

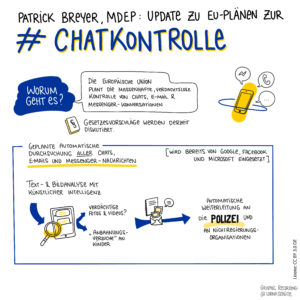

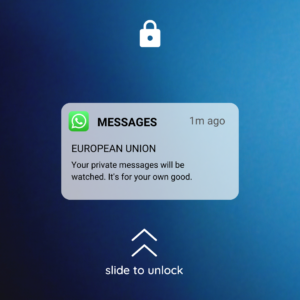

Die EU-Kommission wollte Chat- und Messenger-Providern vorschreiben, private Chats, Nachrichten und E-Mails massenhaft, anlass- und unterschiedslos auf verdächtige Inhalte durchsuchen. Die Begründung: Strafverfolgung von Kinderpornographie. Die Konsequenz: Eine nie dagewesene Massenüberwachung durch vollautomatisierte Echtzeit-Chatkontrolle und damit die Abschaffung des digitalen Briefgeheimnisses.

Weitere Konsequenzen des Gesetzentwurfs zur Chatkontrolle sind unwirksame Netzsperren-Zensur, die Durchleuchtung persönlicher Cloudspeicher einschließlich privater Fotos, durch verpflichtende Altersüberprüfung das Ende anonymer Kommunikation, durch Appstore-Zensur das Ende sicherer Messengerapps und die Bevormundung Jugendlicher.

Chatkontrolle 1.0

Am 6. Juli 2021 hatte bereits eine Mehrheit der Abgeordneten des Europäische Parlaments dem freiwilligen Einsatz der Chatkontrolle zugestimmt (Chatkontrolle 1.0), wovon bisher nur unverschlüsselte US-Kommunikationsdienste wie GMail, Facebook/Instagram Messenger, Skype, Snapchat, iCloud E-Mail oder X-Box Gebrauch machen (Übersicht hier). Die EU hat 2024 eine Verlängerung der befristeten Übergangsverordnung zur freiwilligen Chatkontrolle 1.0 um zwei Jahre bis zum 3. April 2026 beschlossen – siehe Zeitplan und Dokumente. Aktuell hat die EU-Kommission eine Verlängerung um weitere zwei Jahre vorgeschlagen und die EU-Regierungen haben zugestimmt; die Position des EU-Parlaments steht noch aus. Ein Missbrauchsbetroffener klagt gegen die eigenmächtige Chatkontrolle 1.0.

Vorschlag zur verpflichtenden Chatkontrolle 2.0

Die Europäische Kommission hat am 11. Mai 2022 eine Folgeverordnung zum verpflichtenden Einsatz der Chatkontrolle durch alle Anbieter vorgestellt (Chatkontrolle 2.0). Infolge der künftig verpflichtenden Chatkontrolle erwartete die EU-Kommission einen Anstieg der Berichte aus Chatkontrollen um 354%. Eine öffentliche Konsultation der Kommission zu diesem Vorhaben hatte ergeben, dass die Mehrheit der Befragten Bürger:innen und Interessengruppen eine Verpflichtung zum Einsatz der verdachtslosen Nachrichten- und Chatkontrolle ablehnt. Über 80% der Befragten sprachen sich gegen die vorgesehene Anwendung auf Ende-zu-Ende verschlüsselte Kommunikation aus.

Das Parlament hat sich 2023 fast einstimmig gegen eine verdachtslose Chatkontrolle positioniert. Auf Proteste hin wurde die verpflichtende Chatkontrolle Ende 2025 schließlich auch aus dem Gesetzentwurf der EU-Regierungen gestrichen. Dennoch bleibt der Gesetzentwurf der EU-Regierungen zutiefst mangelhaft.

Seit Dezember 2025 laufen die entscheidenden Verhandlungen, in denen der endgültige Gesetzesinhalt zur Chatkontrolle 2.0 festgezurrt wird (Zeitschiene hier). Es droht eine dauerhafte verdachtslose Massenüberwachung privater Nachrichten nach Gutdünken der Anbieter (“freiwillige Chatkontrolle”), eine unwirksame Netzsperren-Zensur, durch verpflichtende Altersüberprüfung das Ende anonymer Kommunikation, durch Appstore-Zensur das Ende sicherer Messengerapps und die Bevormundung Jugendlicher.

Hilf jetzt mit die Chatkontrolle 1.0 zu stoppen!

Aktuell laufen die Verhandlungen zwischen EU-Kommission, EU-Rat und EU-Parlament über den endgültigen Wortlaut des EU-Gesetzes zur Chatkontrolle 2.0 auf der Grundlage dieser Gegenüberstellung der Verhandlungsmandate.

Das Verhandlungsmandat der EU-Regierungen ist brandgefährlich:

- Anlasslose, massenhafte Chatkontrolle auf “freiwilliger” Basis: Die vorübergehende Ermächtigung zur Chatkontrolle 1.0, mit der große US-Anbieter verdachtslos, massenhaft und ohne richterliche Anordnung unsere Chats “freiwillig” durchkämmen, soll zum Dauerzustand werden. Dabei wird nicht nur nach bekanntermaßen illegalen Bildern und Videos gesucht, sondern auch unbekanntes Bildmaterial, private Chat-Texte und Metadaten werden von fehleranfälligen Algorithmen und KI-Systemen automatisiert als “unverdächtig” oder “verdächtig” eingestuft. Bereits heute sind laut BKA rund 50 % aller im Rahmen der freiwilligen “Chatkontrolle 1.0” erfolgten Meldungen strafrechtlich irrelevant – das entspricht Zehntausenden geleakter Chats pro Jahr.

- Abschaffung des Rechts auf anonyme Kommunikation: Um wie im Text gefordert Minderjährige identifizieren zu können, müsste jeder Bürger künftig zur Eröffnung eines E-Mail- oder Messenger-Kontos seinen Ausweis vorlegen oder sein Gesicht scannen lassen. Das ist das faktische Ende der anonymen Kommunikation im Netz – ein Desaster für Whistleblower, Journalisten, politische Aktivisten und Hilfesuchende, die auf den Schutz der Anonymität angewiesen sind.

- „Digitaler Hausarrest“: Teenagern unter 17 Jahren droht mit dem Text der pauschale Ausschluss von WhatsApp, Instagram, Online-Spielen und unzähligen anderen Apps mit Chatfunktion. Digitale Isolation statt Aufklärung, Schutz durch Ausschluss statt Stärkung – das ist bevormundend, lebensfremd und pädagogischer Unsinn.

Wissenschaftler warnen ebenfalls.

Parallel dazu droht die Verlängerung der “Chatkontrolle 1.0”: Weil die Einigung zur Chatkontrolle 2.0 auf sich warten lässt, hat die EU-Kommission vorgeschlagen, die eigentlich im April 2026 auslaufende “Übergangsverordnung” (Verordnung 2021/1232) erneut zu verlängern (Vorschlag COM(2025)0797). Dies droht eine Massenüberwachung zu zementieren, die nur übergangsweise erlaubt werden sollte.

Diese Verordnung zur Chatkontrolle 1.0 erlaubt Anbietern von Kommunikationsdiensten (wie Facebook Messenger, Gmail oder Instagram), vom geltenden Datenschutzrecht (ePrivacy-Richtlinie) abzuweichen. Sie dürfen private Nachrichten, Bilder und Videos aller Nutzer automatisiert und anlasslos scannen, um mit fehleranfälligen Algorithmen und Künstlicher Intelligenz nach verdächtigen Darstellungen und Texten (“Grooming”) zu suchen. Dies geschieht auf rein “freiwilliger” Basis und nach Gutdünken der Konzerne, ohne richterliche Anordnung und ohne jeden Tatverdacht gegen die überwachten Bürger.

Die Gegenargumente gegen eine Fortsetzung dieses Systems wiegen schwer:

- Wortbruch: Das EU-Parlament hat bei der letzten Verlängerung im Jahr 2024 (A9-0021/2024) unmissverständlich klargestellt, dass eine Verlängerung dieser Verordnung “nur ein einziges Mal gerechtfertigt” ist.

- Dauerüberwachung durch die Hintertür: Statt einer rechtsstaatlichen Neuregelung (wie vom Parlament gefordert “Security by Design”), wird die fehleranfällige Massenüberwachung durch US-Konzerne zum Dauerzustand, ohne dass richterliche Beschlüsse gefordert werden.

- Fehlanreize: Solange die Chatkontrolle 1.0 immer wieder verlängert wird, werden Rat und Kommission keinen Druck spüren, sich auf die grundrechtsfreundliche Position des Parlaments zur Chatkontrolle 2.0 einzulassen.

Die Berichterstatterin des EU-Parlaments schlägt eine Verlängerung der Ermächtigung zur anlasslosen Chatkontrolle mit Einschränkungen vor, die jedoch in der Praxis kaum einen Unterschied machen würden – näheres hier. Grüne/Piraten, Linke und Die PARTEI beantragen ein Ende der Chatkontrolle 1.0-Massenscans. Jetzt müssen wir die LIBE-Mehrheit für diesen Weg gewinnen.

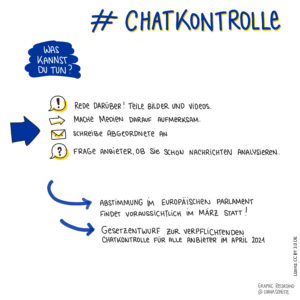

Das kannst du tun

- Bitte die EU-Abgeordneten des zuständigen Innenausschusses (LIBE) eine Verlängerung der Chatkontrolle 1.0 abzulehnen: E-Mail-Tool von fightchatcontrol.eu

- Teile diesen Aufruf zum Handeln online.

Für das Europäische Parlament verhandeln die folgenden LIBE-Abgeordneten federführend über die Verlängerung der Chatkontrolle 1.0:

| EVP (Christdemokraten) | S&D (Sozialdemokraten) | PfE (Rechtsaußen) | Renew (Liberale) | Die Grünen/ EFA | Die Linke | EKR (Nationalkonservative) | ESN (Rechtsaußen) | |

| LIBE | Javier Zarzalejos 🇪🇸 | Birgit Sippel 🇩🇪 (Berichterstatterin) | Antonio Tanger Correa 🇵🇹 | Irena Joveva 🇸🇰 | Marketa Gregorova 🇨🇿 (Piraten) | Isabel Serra Sánchez 🇪🇸 | Jadwiga Wisniewska 🇵🇱 | – |

Tipp: Wenn du mit Politiker*innen in Kontakt treten willst, solltest du möglichst einen echten Brief schreiben, im Büro anrufen oder zu einer lokalen Parteiveranstaltung oder zu Öffnungszeiten des Büros gehen und dort ein persönliches Gespräch führen. Das hat eine noch größere Wirkung als eine E-Mail. Die Kontaktdaten findest du in der Regel auf den Websites der Politiker*innen und der Ortsgruppen der Parteien. Denk daran, dass du deinen Standpunkt entschlossen vertreten, dabei aber auch höflich bleiben solltest, da sie dir sonst nicht zuhören werden.

Hier findest du eine Argumentationshilfe zur Chatkontrolle. Und hier Erklärungen, warum die bisher von den Regierungen vorgesehenen Änderungen nicht ausreichen, um den Gefahren der Chatkontrolle entgegenzuwirken.

Während wir den Kampf gegen die Chatkontrolle fortführen, müssen wir den Widerstand noch weiter ausbauen:

- Erklär deinen Bekannten, warum das ein wichtiges Thema ist. Dieses kurze Video, das in alle europäische Sprachen übersetzt wurde, kann ein hilfreicher Anfang sein. Du kannst es frei nutzen und teilen! Auch verfügbar auf YouTube und PeerTube.

- Aktiv zu werden funktioniert besser und ist motivierender, wenn man zusammenarbeitet. Versuche also, Verbündete zu finden und Allianzen zu schmieden. Ob in einem lokalen Hackspace oder in einem Sportverein: Deine lokale Aktionsgruppe gegen Chatkontrolle kann überall an den Start gehen. Dann könnt ihr kreativ werden und überlegen, welche Art von Aktion am besten zu euch passt.

Werde jetzt aktiv. Der Widerstand gegen die Chatkontrolle sind wir alle!

| Rede darüber! Erzähle anderen von den Gefahren der Chatkontrolle. Hier findest du Sharepics und Videos in allen Sprachen zum Teilen. Unten findest du weitere Bilder zum Teilen. Du kannst natürlich auch selbst Bilder und Videos erstellen. |

| Schaffe Aufmerksamkeit in den Sozialen Medien! Nutze dafür die Hashtags #Chatkontrolle und #digitalesBriefgeheimnis |

| Medienberichte anstoßen! Journalistinnen und Journalisten haben die Nachrichten- und Chatkontrolle bisher kaum aufgegriffen. Wende dich direkt an Medienunternehmen und bitte sie, darüber zu schreiben – online und offline. |

| Sprich mit deinen Anbietern! Vermeide Gmail, Facebook/Instagram Messenger, outlook.com, Snapchat und die Chatfunktion der X-Box, wo schon heute verdachtslos durchleuchtet wird. Frage deine E-Mail-, Messenger- und Chatanbieter, ob sie private Nachrichten verdachtslos nach verbotenen Inhalten durchsuchen oder dies planen. |

| Drucke und verteile Informationsflyer zur Chatkontrolle! Wir haben beispielsweise diesen Flyer erstellt, der druckfertig hier runtergeladen werden kann. |

Sharepics und Info-Grafiken für dich zum Download und Teilen

(Linksklick zum Betrachten, Rechtsklick zum Speichern)

Bildbeschreibungen

Visualisierung der Ergebnisse einer Studie. Links eine Lupe mit einem Smartphone in der Mitte. Umrundet mit einem Ring der zu 80% gefüllt ist. Rechts ein Textkasten mit dem Text: “80% der Minderjährigen sind gegen ein automatisiertes Scannen ihrer Nachrichten nach verdächtigen Inhalten”.

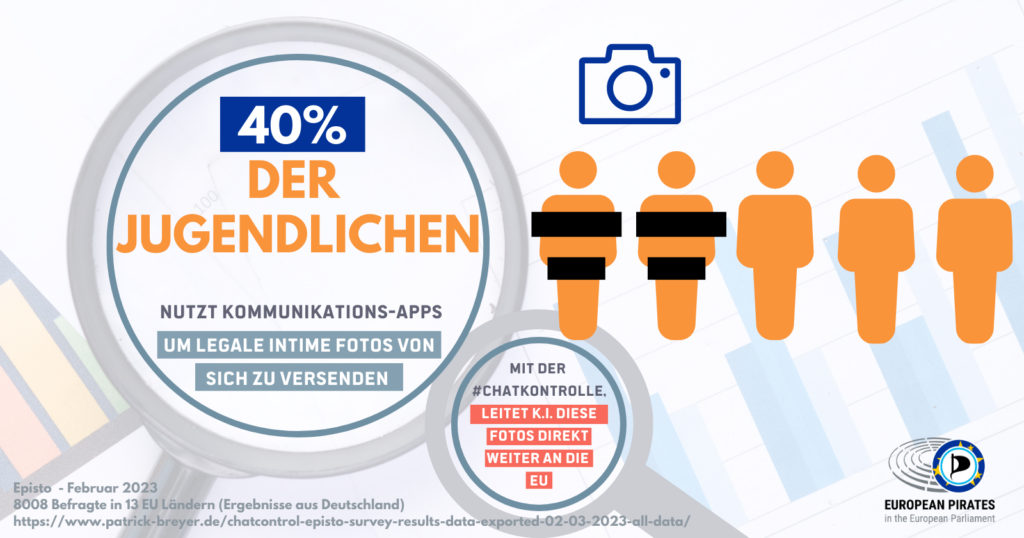

Visualisierung der Ergebnisse einer Studie. Links eine Lupe mit dem Text: “40% der Jugendlichen nutzen Kommunikations-Apps um legale intime Fotos von sich zu versenden”. In einer kleinerer Lupe rechts unten steht: “Mit der #Chatkontrolle leitet die K.I. diese Fotos direkt weiter an die EU”. Rechts auf dem Bild sind Line-Art Menschen zu sehen, die linken zwei mit Zensurbalken.

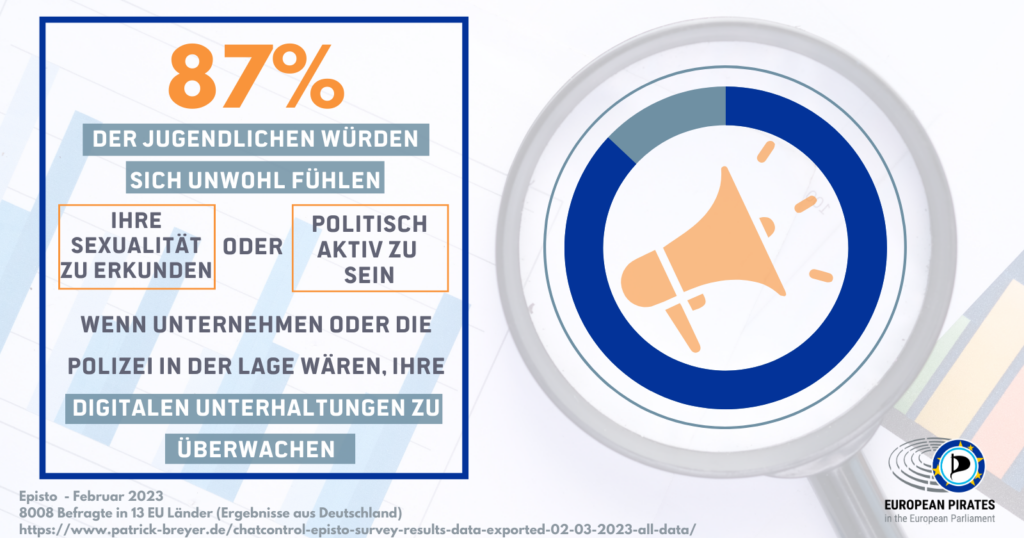

Visualisierung der Ergebnisse einer Studie. Links ist ein Textkasten: “87% der Jugendlichen würden sich unwohl fühlen ihre Sexualität zu erkunden oder politisch aktiv zu sein wenn Unternehmen oder die Polizei in der Lage wären, ihre digitalen Unterhaltungen zu überwachen.” Rechts davon eine Lupe im Hintergrund mit einem Lautsprecher in der Mitte.

Das geplante Gesetz zur Chatkontrolle 2.0

Was konkret im Entwurf der EU-Kommission vorgesehen ist und wie die Verhandlungspositionen des EU-Parlaments und des EU-Rates sind:

| Chatkontrolle-Gesetzentwurf der EU-Kommission | Konsequenzen | Position des EU-Parlaments | Position des EU-Rates |

| Vorgesehen ist die Chatkontrolle, Netzsperren, verpflichtende Altersverifikation für Nachrichten und Chats, Altersverifikation und Ausschluss Minderjähriger von der Installation vieler Apps | keine Chatkontrolle, Netzsperren optional, keine verpflichtende Altersverifikation für Nachrichten und Chats, kein genereller Ausschluss Minderjähriger von der Installation vieler Apps | wie Kommission | |

| Alle Dienste, die normalerweise gegen Entgelt erbracht werden (einschließlich werbefinanzierter Dienste), fallen in den Anwendungsbereich, ohne Mindestgröße, Mindestnutzerzahl usw. | Nur nicht-kommerzielle Dienste, die nicht werbefinanziert sind, wie z. B. vielfach Open-Source-Software, sind ausgenommen | wie Kommission | wie Kommission |

| Auch außerhalb der EU niedergelassene Anbieter sind verpflichtet, die Verordnung umzusetzen | Siehe Artikel 33 | wie Kommission | wie Kommission |

| Als Kommunikationsdienste betroffen sind u.a. Telefonie, E-Mail, Messenger, Chats (auch als Teil von Spielen, auf Datingportalen usw.), Videokonferenzen | Nachrichten, Bilder, Videos und Sprachaufzeichnungen (z.B. Video-Meetings, Sprachnachichten, Telefonaten) müssten durchsucht werden | Telefonie ausgeschlossen, kein Scannen von Nachrichtentexten, betroffen sind E-Mail, Messenger, Chats, Videokonferenzen | wie Parlament |

| Ende-zu-Ende verschlüsselte Messenger sind nicht ausgenommen | Die Anbieter müssen Nachrichten auf jedem Smartphone durchsuchen (client-side scanning) und ggf. unverschlüsselt ausleiten. Das zerstört das Vertrauen in sichere Verschlüsselung und erzwingt eine Hintertür, die eine Überwachung bisher sicher verschlüsselter Kommunikation auch für viele andere Zwecke ermöglicht. | Ende-zu-Ende verschlüsselte Messenger sind ausgenommen | wie Kommission |

| Als Hostingdienste betroffen sind u.a. Webhoster, soziale Medien, Video-Streamingdienste, Filehoster und Clouddienste | Auch persönliche Speicher, die nicht geteilt werden, wie Apples iCloud sind betroffen | wie Kommission | wie Kommission, zusätzlich Suchmaschinen |

| Zur verdachtslosen und flächendeckenden Durchsuchung des Inhalts persönlicher Kommunikation und gespeicherter Daten (Chatkontrolle) verpflichtet werden Dienste, die wahrscheinlich auch für sexuell ausbeutende Darstellungen oder zur Kontaktaufnahme mit Kindern/Jugendlichen genutzt werden | Da vermutlich jeder Dienst auch für illegale Zwecke genutzt wird, werden sämtliche Dienste zur Chatkontrolle verpflichtet | Durchsuchung nur mit richterlichem Beschluss und beschränkt auf Personen oder Personengruppen, die im Verdacht stehen, mit Kinderpornografie und Missbrauchsdarstellungen in Verbindung zu stehen | Anbieter dürfen nach eigenem Ermessen (“freiwillig”) Chats durchsuchen, verdachtslos und ohne richterliche Anordnung |

| Die Behörde des Sitzlandes ist zur Anordnung der Chatkontrolle verpflichtet | Es besteht kein Ermessen | wie Kommission | Die Behörde des Sitzlandes ist für die Durchsetzung zuständig. |

| Bei der Chatkontrolle muss nach bekannten Bildern und Videos gesucht werden, verdächtige Nachrichten/Dateien werden der Polizei angezeigt | Diese Hashverfahren führen laut Schweizer Bundespolizei bisher dazu, dass 80% der Meldungen strafrechtlich irrelevant sind. Auch in Irland wurden nur 20% der im Jahr 2020 eingegangenen NCMEC-Meldungen als tatsächliche “Kinderpornografie” (“CSAM”) bestätigt. In Deutschland sortiert das BKA schon die Hälfte der Meldungen aus. Der prozentuale Anteil der Meldungen, die letztlich in Ermittlungsverfahren münden, liegt über die Jahre relativ konstant im einstelligen Bereich (unter 10%). Laut EU-Innenkommissarin kann die Polizei mit 75% der Meldungen nichts anfangen. Größtenteils werden Unschuldige verdächtigt und teils intime Nacktfotos oder Chats offenbart. | wie Kommission | wie Kommission, aber Anbietern freigestellt |

| Bei der Chatkontrolle muss auch nach unbekannten Bildern und Videos gesucht werden, verdächtige Nachrichten/Dateien werden der Polizei angezeigt | Maschinell nach unbekannten Missbrauchsdarstellungen zu suchen ist ein experimentelles Verfahren unter Verwendung maschinellen Lernens („künstliche Intelligenz“). Die Algorithmen sind Öffentlichkeit und Wissenschaft nicht zugänglich, auch der Entwurf enthält keine Offenlegungspflicht. Die Fehlerquote ist unbekannt und wird durch den Verordnungsentwurf nicht begrenzt, vermutlich führen diese Verfahren zu massenhaft Falschmeldungen. Der Entwurf erlaubt es Providern, Treffermeldungen ungeprüft an die Polizei weiterzugeben. | wie Kommission | wie Kommission, aber Anbietern freigestellt |

| Bei der Chatkontrolle muss im Nachrichtentext maschinell nach möglichen Hinweisen auf Kontaktaufnahmen zu Kindern und Jugendlichen gesucht werden, verdächtige Nachrichten werden der Polizei angezeigt | Maschinell nach Anbahnungsversuchen zu suchen ist ein experimentelles Verfahren unter Verwendung maschinellen Lernens („künstliche Intelligenz“). Die Algorithmen sind Öffentlichkeit und Wissenschaft nicht zugänglich, auch der Entwurf enthält keine Offenlegungspflicht. Die Fehlerquote ist unbekannt und wird durch den Verordnungsentwurf nicht begrenzt, vermutlich führen diese Verfahren zu massenhaft Falschmeldungen. | ausgeschlossen | wie Kommission, aber Anbietern freigestellt |

| Kommunikationsdienste, die für Anbahnungsversuche missbraucht werden können (also alle), müssen das Alter ihrer Nutzer überprüfen | In der Praxis erfolgt eine Altersprüfung mittels vollständiger Identifizierung, so dass eine anonyme Kommunikation per E-Mail, Messenger usw. verboten wird. Auf den Schutz der Anonymität sind Whistleblower, Menschenrechtsverteidiger und marginalisierte Gruppen angewiesen. | keine verpflichtende Altersprüfung | wie Kommission |

| Appstores müssen das Alter ihrer Nutzer überprüfen und Kindern/Jugendlichen unter 16 die Installation von Apps verbieten, die für Anbahnungszwecke missbraucht werden können | Allen Kommunikationsdienste wie Messenger, Datingapps, Spiele können auch zur Anbahnung von Kontakten missbraucht werden (siehe Umfrage) und wären für Kinder/Jugendliche verboten. Und die Altersüberprüfung liefe auf eine Identifikationspflicht gegenüber Anbietern von Appstores heraus. | Fordert die App eine Einwilligung in die Verarbeitung persönlicher Daten, müssen die großen Appstores (Google, Apple) vernünftige Anstrengungen unternehmen, um bei Jugendlichen bis 16 die Einwilligung der Eltern zu überprüfen | wie Kommission |

| Internet-Zugangsanbieter müssen verpflichtet werden, den Zugang zu verbotenen und nicht zu löschenden Bildern und Videos außerhalb der EU mittels Netzsperren (URL-Sperren) zu blockieren | Netzsperren sind technisch unwirksam und leicht zu umgehen, außerdem bauen sie eine technische Zensurinfrastruktur auf | Netzsperren KÖNNEN von Gerichten verhängt werden | wie Kommission |

Verhandlungsmandat des Europäischen Parlaments

Im November 2023 hat das Europäische Parlament fast einstimmig ein gemeinsames Verhandlungsmandat zum Gesetzentwurf beschlossen. Mit dem Europaabgeordneten der Piratenpartei Dr. Patrick Breyer saß der entschiedenste Gegner einer Chatkontrolle mit am Verhandlungstisch. Das Ergebnis: Das Parlament will dem extremen Entwurf der EU-Kommission folgende Giftzähne ziehen:

- Wir wollen das digitale Briefgeheimnis retten und die grundrechtswidrigen Pläne flächendeckender verdachtsloser Chatkontrollen stoppen. Auch die aktuelle freiwillige Chatkontrolle privater Nachrichten (nicht sozialer Netzwerke) durch US-Internetkonzerne soll auslaufen. Eine zielgerichtete Telekommunikationsüberwachung und -durchsuchung soll nur auf richterliche Anordnung und nur beschränkt auf Personen oder Personengruppen zugelassen, die im Verdacht stehen, mit Kinderpornografie und Missbrauchsdarstellungen in Verbindung zu stehen.

- Wir wollen das Vertrauen in sichere Ende-zu-Ende-Verschlüsselung retten. Das sogenannte client-side scanning, also den Einbau von Überwachungsfunktionen und Sicherheitslücken in unsere Smartphones, schließen wir klar aus.

- Wir wollen das Recht auf anonyme Kommunikation garantieren und eine Altersnachweispflicht für Benutzer von Kommunikationsdiensten ausschließen. Whistleblower könnten so weiterhin Missstände anonym leaken, ohne Ausweis oder Gesicht vorzeigen zu müssen.

- Löschen statt sperren: Netzsperren sollen nicht verhängt werden müssen. Auf keinen Fall sollen zulässige Inhalte als „Kollateralschaden“ mitgesperrt werden.

- Wir wollen keine App-Verbote für junge Menschen: Appstores sollen junge Menschen unter 16 nicht wie geplant ‘zu ihrem eigenen Schutz’’’ an der Installation von Messengerapps, sozialen Netzwerken und Spielen hindern müssen. Es bleibt bei der Datenschutz-Grundverordnung.

Junge Menschen und Missbrauchsopfer wollen wir viel wirksamer schützen als im Entwurf der EU-Kommission vorgesehen:

- Security by design: Um junge Menschen vor sexueller Ansprache und Ausbeutung zu schützen, sollen Internetdienste und Apps sicher ausgestaltet und voreingestellt werden. Es muss möglich sein, andere Nutzer zu blockieren und zu melden. Nur auf Wunsch des Nutzers soll dieser öffentlich ansprechbar sein und Nachrichten oder Bilder anderer Nutzer sehen. Vor dem Verschicken von Kontaktdaten oder Nacktbildern wird rückgefragt. Potenzielle Täter und Opfer werden bei konkretem Anlass gewarnt, beispielsweise wenn versucht wird anhand bestimmter Suchworte nach Missbrauchsmaterial zu suchen. Öffentliche Chats sind bei hohem Grooming-Risiko zu moderieren.

- Das Netz säubern: Um das Netz von Kinderpornografie und Missbrauchsdarstellungen zu säubern, soll das neue EU-Kinderschutzzentrum proaktiv öffentlich abrufbare Internetinhalte automatisiert nach bekannten Missbrauchsdarstellungen durchsuchen. Dieses Crawling ist auch im Darknet einsetzbar und dadurch effektiver als Privatüberwachungsmaßnahmen der Anbieter.

- Löschpflicht: Anbieter, die auf eindeutig illegales Material aufmerksam werden, sollen – anders als von der EU-Kommission vorgeschlagen – zur Löschung verpflichtet werden. Strafverfolger, die auf illegales Material aufmerksam werden, sollen dies dem Anbieter zur Löschung melden müssen. Damit reagieren wir auf den Fall der Darknetplattform Boystown, bei der schlimmstes Missbrauchsmaterial mit Wissen des Bundeskriminalamts monatelang weiter verbreitet wurde.

Position der EU-Regierungen im Rat

Die Ratspräsidentschaft musste nach massiven Protesten versprechen, die verpflichtende Chatkontrolle zu streichen. Sie hat inzwischen auch eine faktisch verpflichtende Chatkontrolle durch die Hintertür des Artikel 4 („Risikominderung“) ausgeschlossen.

Andere massive Probleme bestehen fort:

- Ausweitung des Scannens auf Texte und Metadaten: Der neue Text soll die im Ermessen der Anbieter stehende “freiwillige” Chatkontrolle weit über visuelle Inhalte hinaus legitimieren. Er ermöglicht die höchst fehleranfällige Analyse von Texten nach Schlüsselwörtern zur Aufdeckung von „Grooming“. Ein Algorithmus kann nicht zwischen einem Witz, Sarkasmus und einer kriminellen Handlung unterscheiden. Das führt zu massenhaften Falschmeldungen und schränkt die Meinungsfreiheit ein.

- Unzuverlässige „KI“ für unbekannte Inhalte: Statt nur bekannte Darstellungen (CSAM) per Hash-Abgleich zu suchen, soll nach dem Ermessen der Anbieter eine KI unbekannte Inhalte bewerten dürfen. Diese Technologien sind bekanntermaßen unzuverlässig und können weder Alter noch Einvernehmlichkeit erkennen. Laut Bundeskriminalamt sind schon heute fast 50 % der Meldungen strafrechtlich irrelevant. Das überlastet die Behörden und gibt unschuldige, private Bilder Fremden preis.

- Recht auf anonyme Kommunikation wird abgeschafft: Um Minderjährige zu identifizieren, müsste jeder Bürger für ein E-Mail- oder Messenger-Konto sein Alter mit Ausweis oder Gesichtsscan nachweisen. Das bedroht Whistleblower, Journalisten und Hilfesuchende.

- „Digitaler Hausarrest“ für Teenager: Die geplante Alterskontrolle würde Nutzer unter 17 Jahren von alltäglichen Apps wie WhatsApp, Instagram und Online-Spielen ausschließen, sie isolieren und entmündigen.

Position der Bundesregierung

Die Bundesregierung hat sich eigentlich klar gegen anlasslose Chatkontrolle ausgesprochen – sowohl Vertreter der Bundesregierung (wie Justizministerin Hubig, SPD) als auch der Bundestagsfraktionen (wie Jens Spahn, CDU) lehnen sie ab. Auch die jetzt geplante “freiwillige Chatkontrolle” ist aber anlasslos, verdachtslos und massenhaft. Die Bundesregierung muss auf den Korrekturen bestehen, die auch das Europäische Parlament fordert: keine Massenüberwachung, sondern gezielte Ermittlungen gegen Verdächtige auf richterliche Anordnung.

Zu den übrigen Kritikpunkten hat sich die Bundesregierung bisher nicht geäußert, sie stimmt dem gefährlichen Ratstext zu.

Videos zur Chatkontrolle sind in dieser Playlist hinterlegt.

Die Verhandlungsführer

Für das Europäische Parlament verhandeln die folgenden LIBE-Abgeordneten zur Chatkontrolle 2.0 (die IMCO-Abgeordneten geben nur eine Stellungnahme ab):

| EVP (Christdemokraten) | S&D (Sozialdemokraten) | PfE (Rechtsaußen) | Renew (Liberale) | Die Grünen/ EFA | Die Linke | EKR (Nationalkonservative) | ESN (Rechtsaußen) | |

| LIBE (federführend) | Javier Zarzalejos (Berichterstatter) | Alex Aguis Saliba | Antonio Tanger Correa | Hilde Vautmans | Marketa Gregorova (Piraten) | Isabel Serra Sánchez | Jadwiga Wisniewska | Ewa Zajączkowska-Hernik |

| IMCO (mitberatend) | Alex Aguis Saliba 🇲🇹(Mitberatender Berichterstatter) | Elisabeth DIERINGER🇦🇹 | Stéphanie YON-COURTIN 🇫🇷 | Kim VAN SPARRENTAK 🇳🇱 | Hanna GEDIN 🇸🇪 | Piotr MÜLLER 🇵🇱 |

Verhandlungsführer für den Rat der EU: die nationalen Innenminister (federführend) werden in den Verhandlungen durch die Ratspräsidentschaft vertreten – also durch Zypern ab dem 01.01.2026.

Verhandlungsführer für die EU-Kommission: EU-Kommissar für Inneres Magnus Brunner (federführend).

Die Verhandlungen zur Chatkontrolle 2.0: Zeitschiene und Termine

- Voraussichtlich Juli 2026: Verabschiedung der finalen Verordnung

- 29. Juni 2026: Vierte und abschließende Trilogverhandlung über die endgültige Fassung der Verordnung

- 4. Mai 2026: Dritte Trilogverhandlung über die endgültige Fassung der Verordnung

- 26. Februar 2026: Zweite Trilogverhandlung über die endgültige Fassung der Verordnung

- 9. Dezember 2025: Treffen der Verhandler des EU-Parlaments

- 9. Dezember 2025: Erste Trilogverhandlung über die endgültige Fassung der Verordnung zwischen Kommission, Parlament und Rat

- 4. Dezember 2025: LIBE-Befragung von Innenkommissar Brunner

- 19. November 2025: Ausschuss der Ständigen Vertreter der EU-Regierungen – Annahme der Chatkontrolle 2.0 ohne Aussprache

- 12. November 2025: Treffen der Ratsarbeitsgruppe Strafverfolgung zur Chatkontrolle 2.0

- 5. November 2025: Ausschuss der Ständigen Vertreter der EU-Regierungen zur Chatkontrolle 2.0

- 14. Oktober 2025:

Beratung (nicht Abstimmung) durch die EU-Innenminister(von Tagesordnung gestrichen) - 8. Oktober 2025: Ausschuss der Ständigen Vertreter der Regierungen der Mitgliedstaaten der Europäischen Union

- 12. September 2025: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 11. Juli 2025: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- weitere Treffen siehe Ratsdokumente

- 21. Mai 2025: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 5. Februar 2025: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 12. Dezember 2024: Beratung durch die EU-Innenminister (Rat „Justiz und Inneres“)

- 9. Dezember 2024: Beratung und Abstimmung im Ausschuss der ständigen Vertreter

- 10. Oktober 2024: Beratung durch die EU-Innenminister (Rat „Justiz und Inneres“), Livestream ab 12.50 Uhr sowie Aufzeichnung hier

- 7. Oktober 2024: Beratung und möglicherweise Annahme im Ausschuss der ständigen Vertreter

2. Oktober 2024: Beratung und möglicherweise Annahme im Ausschuss der ständigen Vertreter(vertagt)- 23. September 2024: Beratung des neuesten Vorschlags in der Ratsarbeitsgruppe Justiz- und Inneres

- 4. September 2024: Beratung des Ausschusses der ständigen Vertreter

- 20. Juni 2024: Gescheiterte Abstimmung im Ausschuss der ständigen Vertreter zur verpflichtenden Chatkontrolle 2.0

- 13. Juni 2024: Befassung der EU-Innenminister mit der verpflichtenden Chatkontrolle 2.0

- 13. Juni 2024: Präsentation Fortschrittsbericht und Diskussion der Innenminister zur verpflichtenden Chatkontrolle 2.0

- 4. Juni 2024: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 24. Mai 2024: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 8. Mai 2024: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 15. April 2024: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 10. April 2024: Abstimmung des Europäischen Parlaments über die Verlängerung der freiwilligen Chatkontrolle 1.0

- 3. April 2024: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 19. März 2024: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- 5. März 2024: Beratung der EU-Innenminister über die verpflichtende Chatkontrolle (Chatkontrolle 2.0)

- 4. März 2024: Abstimmung des LIBE-Ausschusses über das Trilog-Ergebnis zur Verlängerung der freiwilligen Chatkontrolle (Chatkontrolle 1.0)

- 1. März 2024: Treffen der Ratsarbeitsgruppe Strafverfolgung zur verpflichtenden Chatkontrolle 2.0

- zweite Februarwoche 2024 (geplant): Einigung zwischen Europäischem Parlament und EU-Regierungen (EU-Rat) über Verlängerung der freiwilligen Chatkontrolle (Chatkontrolle 1.0)

- 12. Februar 2024: Trilogverhandlungen über die Verlängerung der freiwilligen Chatkontrolle (Chatkontrolle 1.0)

- 7. Februar 2024: Abstimmung des Europäischen Parlaments über das Mandat zur Verlängerung der freiwilligen Chatkontrolle (Chatkontrolle 1.0)

- 5. Februar 2024: Ankündigung der Abstimmung des Europäischen Parlaments über die Verlängerung der freiwilligen Chatkontrolle (Chatkontrolle 1.0)

- 29. Januar 2024: Abstimmung im LIBE-Ausschuss über die Verlängerung der freiwilligen Chatkontrolle (Chatkontrolle 1.0)

- 25. Januar 2024: Treffen der Schattenberichterstatter (Chatkontrolle 1.0)

- 22. Januar 2024: Frist zum Einreichen von Änderungsanträgen (Chatkontrolle 1.0)

- 17. Januar 2024: Berichtsentwurf zur Verlängerung der freiwilligen Chatkontrolle (Chatkontrolle 1.0)

- 4. Dezember 2023: Die EU-Kommission hat die Justiz- und Innenminister “informiert”

- 1. Dezember 2023: Die Ratspräsidentschaft hat die Arbeitsgruppe Strafverfolgung über den “Stand der Dinge” informiert

- 30. November 2023: EU-Kommission schlägt Verlängerung der freiwilligen Chatkontrolle 1.0 vor

- 23. November 2023: Mangels Widerspruchs keine Abstimmung über das im LIBE-Ausschuss beschlossene Verhandlungsmandat im Plenum

- 14. November 2023: Im LIBE-Ausschuss fast einstimmige Annahme der Parlamentsposition und des Mandats zu Trilogverhandlungen

- 25. Oktober 2023: LIBE-Anhörung von Innenkommissarin Johansson zu Lobbyismusvorwürfen

- 24. Oktober 2023: Treffen der Schattenberichterstatter

- 18. Oktober 2023: Treffen der Schattenberichterstatter

- 16. Oktober 2023: Debatte im Ausschuss der Ständigen Vertreter des Rats

- Treffen der Schattenberichterstatter siehe Kalendereinträge zu CSAM

- 20. September 2023: Treffen der Stellvertreter der Ständigen Vertretungen

- 17. September 2023: Treffen der Ratsarbeitsgruppe Strafverfolgung (Kompromisvorschlag)

- 14. September 2023: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 5. September 2023: Treffen der Schattenberichterstatter

- 19. Juli 2023: Treffen der Schattenberichterstatter

- 12. Juli 2023: Treffen der Schattenberichterstatter

- 5. Juli 2023: Treffen der Schattenberichterstatter

- 28. Juni 2023: Treffen der Schattenberichterstatter

- 14. Juni 2023: Treffen der Schattenberichterstatter

- 8. und 9. Juni 2023: Rat “Justiz und Inneres” soll partielle Einigung festlegen (Kompromisvorschlag)

- 7. Juni 2023: Treffen der Schattenberichterstatter

31. Mai 2023: Treffen der Schattenberichterstatter- 31. Mai 2023: Treffen der Stellvertreter der Ständigen Vertretung

- 25. – 26. Mai 2023: Treffen der Ratsarbeitsgruppe Strafverfolgung (Kompromisvorschlag)

- 17. Mai 2023: Frist des EP für die Einreichung von Änderungsanträgen

- 26. April 2023: Präsentation des Berichtsentwurfs in LIBE

- 25. April 2023: Treffen der Ratsarbeitsgruppe Strafverfolgung (Kompromisvorschlag)

- 14. April 2023: EP-Berichterstatter reicht Berichtsentwurf ein

- 13. April 2023: Präsentation des Impact Assessment in LIBE

- 29. März 2023: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 21. März 2023: Treffen der Schattenberichterstatter

- 16. März 2023: Treffen der Ratsarbeitsgruppe Strafverfolgung (Kompromisvorschlag)

- 7. März 2023: Treffen der Schattenberichterstatter

- 27. Februar 2023: Treffen der Schattenberichterstatter

- 7. Februar 2023: Treffen der Schattenberichterstatter

- 24. Januar 2023: Treffen der Schattenberichterstatter: Anhörungen (Fokus: Strafverfolgung)

- 19. & 20. Januar 2023: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 10. Januar 2023: Treffen der Schattenberichterstatter: Anhörungen

- 14. Dezember 2022: Treffen der Schattenberichterstatter: Anhörungen

- 8. – 9. Dezember 2022: Tagung des des Rates „Justiz und Inneres“ in Brüssel

- 30. November 2022: Erstes treffen der Schattenberichterstatter des Europäischen Parlaments

- 24. November 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung (Altersverifikation)

- 3. November 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 19. Oktober 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 10. Oktober 2022: Der Vorschlag wurde präsentiert und diskutiert im führenden Ausschuss (LIBE) – Videoaufzeichnung

- 5. Oktober 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 28. September 2022: Ratsworkshop zu Durchsuchungstechnologien

- 22. September 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung (Kompromissvorschlag: Artikel 1&2, Artikel 25-39)

- 6. September 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 25. Juli 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung (Kompromissvorschlag)

- 5. Juli 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 22. Juni 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung

- 8. Mai 2022: Treffen der Ratsarbeitsgruppe Strafverfolgung

11. Mai 2022: Die Kommission stellt einen Gesetzesentwurf vor, der zur Chatkontrolle verpflichtet

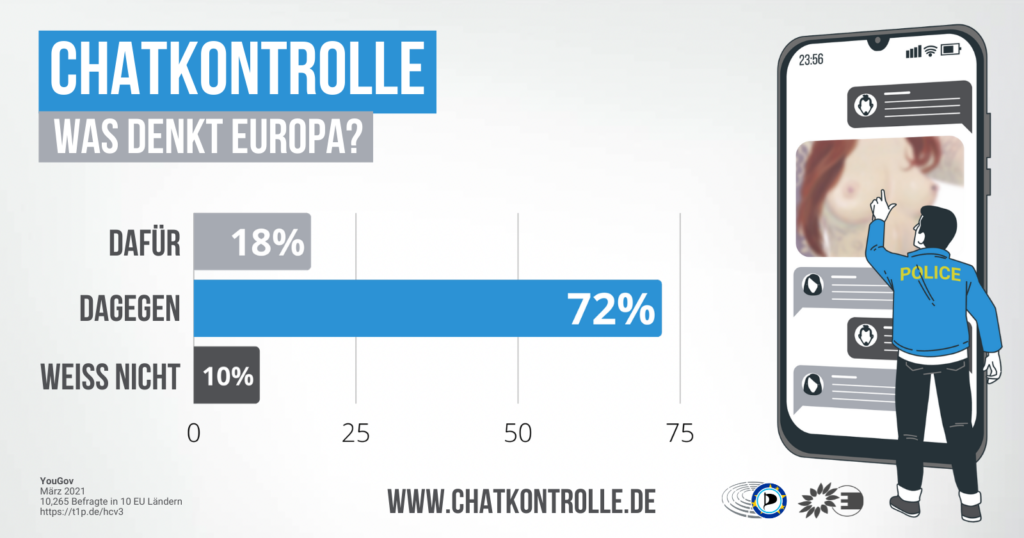

Die EU-Kommission will mit einem zweiten Gesetz nun alle Anbieter zum Einsatz dieser Technologie verpflichten. Dabei zeigt eine im März 2021 durchgeführte Umfrage, dass die Mehrheit der EuropäerInnen den Einsatz der Chatkontrolle entschieden ablehnt. (Detaillierte Umfrageergebnisse hier)

9. Mai 2022: Mitglied des Europäischen Parlaments Patrick Breyer reicht eine Klage gegen das US-Unternehmen Meta ein

Nach einem Urteil des Europäischen Gerichtshofs ist die dauerhafte und flächendeckende automatisierte Analyse privater Kommunikation grundrechtswidrig und verboten (Abs. 177). Die ehemalige EuGH-Richterin, Prof. Dr. Ninon Colneric, kommt in ihrem Rechtsgutachten (englisch) zu dem Ergebnis, dass die EU-Gesetzesvorhaben zur Chatkontrolle nicht im Einklang mit der Rechtsprechung des Europäischen Gerichtshofs stehen und die Grundrechte aller EU-Bürger*innen auf Achtung der Privatsphäre, auf Datenschutz und auf freie Meinungsäußerung verletzen. Auch der Wissenschaftliche Dienst des Bundestags stellt fest: “Die latente Dauergefahr der Begehung von (auch schwerwiegenden) Straftaten dürfte daher zur Rechtfertigung einer ständigen und umfassenden automatisierten Analyse wohl nicht genügen.” Der Europaabgeordnete Patrick Breyer hat aus diesem Grund das US-Unternehmen Meta wegen der freiwillig praktizierten Chatkontrolle verklagt.

6. Juli 2021: Das europäische Parlament stimmt für die Einführung der Chatkontrolle

Das Europäische Parlament hat für die ePrivacy-Ausnahmeregelung gestimmt, die eine freiwillige Chat-Kontrolle für Messaging- und E-Mail-Anbieter ermöglicht. Infolgedessen führen einige US-amerikanische Anbieter von Diensten wie Gmail und Outlook.com bereits solche automatisierten Messaging- und Chat-Kontrollen durch.

2020: Die europäische Kommission schlägt ein zeitlich begrenztes Gesetz vor welches die Chatkontrolle erlaubt

Die Europäische Kommission hat 2020 ein Gesetz auf den Weg gebracht, das es erlaubt, alle privaten Chats, Nachrichten und E-Mails verdachtslos und flächendeckend auf verbotene Darstellungen Minderjähriger und Anbahnungsversuche (Kontaktaufnahme zu Minderjährigen) zu durchsuchen. Das heißt: Facebook Messenger, Gmail & Co dürfen jede Kommunikation auf verdächtiges Text- und Bildmaterial scannen. Und zwar vollautomatisiert, durch den Einsatz von sog. ‘Künstlicher Intelligenz’ – ohne, dass ein Verdacht vorliegen muss. Meldet ein Algorithmus einen Verdachtsfall, werden alle Nachrichteninhalte und Kontaktdaten automatisch und ohne menschliche Prüfung an eine private Verteilstelle und weiter an Polizeibehörden weltweit geleitet. Die Betroffenen sollen nie davon erfahren.

Was hat das Ganze mit dir zu tun?

Nachrichten- und Chatkontrolle:

- Alle deine Chats und E-Mails werden automatisch auf verdächtige Inhalte durchsucht. Nichts ist mehr vertraulich oder geheim. Kein Gericht muss diese Durchsuchung anordnen. Sie passiert immer und automatisch.

- Falls die Maschinenprüfung anschlägt, werden deine privaten Fotos und Videos von Mitarbeitern von internationalen Konzernen und Polizeibehörden angesehen. Auch intime Nacktbilder von dir werden dann von unbekannten Menschen auf der ganzen Welt gesichtet, in deren Hände sie nicht sicher sind.

- Flirts und Sexting werden mitgelesen, denn Texterkennungsfilter schlagen besonders häufig auf solche intimen Chats an.

- Du kannst unschuldig in den Verdacht geraten, Material von Kindesmissbrauch zu verschicken. Denn die Bilderkennungsfilter sind bekannt dafür, dass sie auch auf völlig legale Urlaubsfotos mit Kindern am Strand anschlagen. 80% aller maschinell gemeldeten Verdachtsfälle erweisen sich als unbegründet, so die Schweizer Bundespolizei. Auch in Irland wurden nur 20% der im Jahr 2020 eingegangenen NCMEC-Meldungen als tatsächliche “Kinderpornografie” (“CSAM”) bestätigt. In Deutschland liegt der prozentuale Anteil der Meldungen, die letztlich in Ermittlungsverfahren münden, über die Jahre relativ konstant im einstelligen Bereich (unter 10%). Größtenteils werden Unschuldige verdächtigt und teils intime Nacktfotos oder Chats offenbart. Knapp 40% aller in Deutschland wegen “Kinderpornografie” von der Polizei verfolgter Personen sind Minderjährige.

“Die Trefferquote ist dabei sehr tief: «2020 trafen bei uns rund 8000 Meldungen ein», sagt Fedpol-Sprecher Florian Näf. «Strafrechtlich relevant waren davon zirka 14 Prozent.»”

Quelle: Sonntagszeitung vom 14.03.2021, Seite 9

2021 waren 20% der Meldungen strafrechtlich relevant

“Und auch hierzulande bekommen die Ermittler von Google jede Menge falsche Alarmmeldungen aufgetischt, ergaben die Recherchen der WELT AM SONNTAG schon 2021: Laut Experten des Landeskriminalamts NRW lag die Fehlerquote in der Vergangenheit bei etwa 40 Prozent.”

Quelle: Die Welt, 23.08.2022

- Bei deiner nächsten Auslandsreise könnten dich große Probleme erwarten. Verdachtsmeldungen werden unkontrollierbar an Staaten wie die USA, wo es keinerlei Datenschutz gibt, weitergeleitet – mit unabsehbaren Konsequenzen.

- Geheimdienste und Hacker können einfacher Zugriff auf deine privaten Chats und E-Mails erhalten. Denn sobald sichere Verschlüsselung für den Einsatz der Chatkontrolle ausgehebelt wird, ist die Tür offen zum massenhaften Auslesen deiner Nachrichten durch jeden, der die technischen Mittel dazu hat.

- Das ist nur der Anfang. Ist die Technologie zur Nachrichten- und Chatkontrolle einmal etabliert, kann sie spielend leicht auch für andere Zwecke eingesetzt werden. Und wer garantiert, dass die Verdächtigungsmaschinen künftig nicht auch unsere Smartphones und Laptops kontrollieren?

Altersprüfung und App-Verbot unter 16:

- Du kannst nicht mehr anonym E-Mail- oder Messenger-Konten einrichten oder anonym chatten, ohne dich ausweisen oder dein Gesicht zeigen zu müssen, wodurch du identifizierbar wirst und Datenlecks riskierst. Dies verhindert zum Beispiel sensible Chats zum Thema Sexualität im Schutz der Anonymität, anonyme Pressekommunikation mit Quellen (z. B. Whistleblowern) sowie politische Aktivitäten.

- Unter 16 Jahren wirst du aus dem Appstore beispielsweise folgende Apps nicht mehr installieren können (Begründung: Grooming-Gefahr): Messenger wie Whatsapp, Snapchat, Telegram oder Twitter, soziale Medien wie Instagram, TikTok oder Facebook, Spiele wie FIFA, Minecraft, GTA, Call of Duty, Roblox, Dating Apps, Videokonferenzen wie Zoom, Skype, Facetime.

- Wenn du keinen Appstore nutzt, wird die Einhaltung des vom Anbieter festgesetzten Mindestalters überprüft werden. Wenn du nicht das von Whatsapp festgelegte Mindestalter von 16 Jahren erreichst, wirst du Whatsapp aufgrund der geplanten Altersverifizierung nicht mehr nutzen können; dasselbe gilt für die Onlinefunktionen des Spiels FIFA 23. Wenn du unter 13 Jahre alt bist, kannst du TikTok, Snapchat oder Instagram nicht mehr nutzen.

Weitere Argumente gegen die Chatkontrolle

Mythen entlarvt

Bei der erstmaligen Präsentation des Gesetzesentwurfs zur Chatkontrolle im Mai 2022 hatte die EU-Kommission das umstrittene Vorhaben mit verschiedenen Argumenten beworben. Im Folgenden werden diverse Behauptungen hinterfragt:

1. „Heutzutage werden Fotos und Videos, die den sexuellen Missbrauch von Kindern zeigen, im Internet massiv verbreitet. Im Jahr 2021 wurden beim US-amerikanischen National Centre for Missing and Exploited Children 29 Millionen Fälle gemeldet.“

Im Zusammenhang mit der Chatkontrolle ausschließlich von Darstellungen sexuellen Kindesmissbrauchs zu reden, ist irreführend. Bei sexuell ausbeutenden Darstellungen Minderjähriger (child sexual exploitation material, CSEM) handelt es sich zwar oft um Aufnahmen sexualisierter Gewalt an Minderjährigen (child sexual abuse material, CSAM). Eine internationale Arbeitsgruppe aus Kinderschutzinstitutionen weist aber darauf hin, dass zum strafbaren Material auch Aufnahmen sexueller Handlungen oder von Sexualorganen Minderjähriger zählen, bei denen keine Gewalt angewendet wird oder auch keine andere Person beteiligt ist. Auch in Alltagssituationen entstandene Aufnahmen werden genannt wie ein Familienbild eines Mädchens im Bikini oder nackt in den Stiefeln ihrer Mutter. Erfasst sind auch ohne Wissen der minderjährigen Person angefertigte oder weitergegebene Aufnahmen. Zu strafbarem CSEM zählen auch Comics, Zeichnungen, Manga/Anime und computergenerierte Darstellungen fiktionaler Minderjähriger. Schließlich gehören zu strafbaren Darstellungen auch selbst gemachte sexuelle Aufnahmen Minderjähriger etwa zur Weiterleitung an gleichaltrige Partner („Sexting“). Die Studie schlägt zur korrekten Umschreibung deshalb den Begriff „Darstellungen der sexualisierten Ausbeutung“ von Minderjährigen vor. Strafbar sind dabei gleichermaßen Aufnahmen von Kindern (bis 14 Jahre) und von Jugendlichen (bis 18 Jahre).

2. “Allein im Jahr 2021 wurden weltweit 85 Millionen Bilder und Videos von sexuellem Kindesmissbrauch gemeldet.”

Es kursieren viele irreführende Angaben darüber, wie das Ausmaß sexuell ausbeutender Darstellungen Minderjähriger (CSEM) beziffert werden kann. Die Zahl, mit der die EU-Kommission ihre Pläne verteidigt, stammt von der US-amerikanischen Nichtregierungsorganisation NCMEC (National Center for Missing and Exploited Children) und umfasst auch Duplikate, da CSEM mehrfach geteilt und oft nicht gelöscht wird. Ohne Duplikate verbleiben von den 85 Millionen gemeldeten Aufnahmen noch 22 Millionen einzigartige Aufnahmen.

75 Prozent aller NCMEC-Meldungen aus dem Jahr 2021 stammen von Meta (FB, Instagram, Whatsapp). Facebooks eigene interne Analyse besagt, dass “mehr als 90 Prozent von [CSEM auf Facebook im Jahr 2020] mit zuvor gemeldeten Inhalten identisch oder ihnen visuell ähnlich waren. Und Kopien von nur sechs Videos waren für mehr als die Hälfte der kinderausbeutenden Inhalte verantwortlich”. Die viel zitierten Zahlen des NCMEC beschreiben also nicht wirklich das Ausmaß der Aufnahmen von sexualisierter Gewalt gegen Kinder im Internet. Sie beschreiben vielmehr, wie oft Facebook Kopien von bereits bekannten Aufnahmen entdeckt. Auch das ist relevant.

Nicht alle einzigartigen Aufnahmen, die der NCMEC gemeldet werden, zeigen Gewalt gegen Kinder. Die 85 Millionen von NCMEC gemeldeten Darstellungen beinhalten zum Beispiel auch einvernehmliches Sexting. Die Anzahl von Missbrauchsdarstellungen, die NCMEC im Jahr 2021 gemeldet wurden, betrug 1,4 Millionen.

7% der weltweiten Verdachtsmeldungen von NCMEC gehen an die Europäische Union.

Darüber hinaus steigen selbst auf Facebook, wo die Chatkontrolle seit langem freiwillig eingesetzt wird, die Zahlen für die Verbreitung von missbräuchlichem Material immer weiter an. Die Chatkontrolle ist somit keine Lösung.

Quelle: https://netzpolitik.org/2022/ncmec-zahlen-erklaert-das-raunen-vom-millionenfachen-missbrauch/

3. “64% Anstieg der Berichte über bestätigten sexuellen Kindesmissbrauch im Jahr 2021 im Vergleich zum Vorjahr.“

Dass die Algorithmen zur freiwilligen Chatkontrolle großer US-Anbieter mehr CSEM gemeldet haben, lässt keinen Rückschluss darauf zu, wie sich die Menge an CSEM insgesamt entwickelt hat. Schon die Konfiguration der Algorithmen hat großen Einfluss auf die Zahl der Verdachtsmeldungen. Im Übrigen zeigt der Anstieg, dass sich die Zirkulation von CSEM mithilfe einer Chatkontrolle nicht in den Griff bekommen lässt.

4. “Europa ist die globale Drehscheibe für dem Großteil des Materials.”

7% der weltweiten Verdachtsmeldungen von NCMEC gehen an die Europäische Union. Im Übrigen melden europäische Strafverfolgungsbehörden wie Europol und BKA wissentlich Missbrauchsmaterial nicht den Speicherdiensten zur Entfernung, so dass die Menge des hier gespeicherten Materials nicht sinken kann.

5. “Eine von Europol unterstützte Untersuchung, die auf der Meldung eines Online-Diensteanbieters beruhte, führte zur Rettung von 146 Kindern weltweit, wobei über 100 Verdächtige in der gesamten EU identifiziert wurden.”

Der Bericht wurde von einem Anbieter von Cloud-Speichern und nicht von einem Kommunikationsdienstleister erstellt. Zur Durchleuchtung von Cloudspeichern ist es nicht notwendig, die Überwachung der Kommunikation aller Menschen vorzuschreiben. Wenn man die Täter von Online-Verbrechen im Zusammenhang mit Kindesmissbrauchsmaterial erwischen möchte, sollte man sogenannte Honeypots und andere Methoden verwenden, die nicht die Überwachung der Kommunikation der gesamten Bevölkerung erfordern.

6. „Die bestehenden Möglichkeiten zur Aufdeckung entsprechender Inhalte werden nicht mehr zur Verfügung stehen, wenn die gegenwärtige Übergangslösung ausläuft.“

Anbieter von Speicherdiensten (Filehoster, Clouds) und von sozialen Medien dürfen auch nach Auslaufen der ePrivacy-Ausnahmeverordnung weiter scannen. Für Anbieter von Kommunikationsdiensten könnte die Ausnahmeverordnung zur freiwilligen Chatkontrolle verlängert werden, ohne dass sämtliche Anbieter zur Durchsuchung verpflichtet werden müssten.

7. Metaphern: Die Chatkontrolle ist “wie ein Spam-Filter” / “wie ein Magnet, der nach einer Nadel im Heuhaufen sucht: der Magnet sieht das Heu nicht.” / “wie ein Polizeihund, der Briefe erschnüffelt: er hat keine Ahnung, was drin ist”. Der Inhalt Ihrer Kommunikation wird von niemandem eingesehen, wenn es keinen Treffer gibt. “Die Erkennung zu Zwecken der Cybersicherheit findet bereits statt, wie z. B. die Erkennung von Links in WhatsApp” oder Spam-Filtern.

Malware- und Spamfilter geben den Inhalt privater Kommunikation nicht an Dritte weiter und führen nicht dazu, dass unschuldige Menschen angezeigt werden. Sie führen nicht zur Löschung oder langfristigen Sperrung von Profilen in sozialen Medien oder von Online-Diensten.

8. “Was die Erkennung neues Missbrauchsmaterials im Netz betrifft, so liegt die Trefferquote deutlich über 90 %. … Einige der bestehenden Technologien zur Erkennung von Grooming (wie die von Microsoft) haben eine “Genauigkeitsrate” von 88%, vor der menschlichen Überprüfung.”

Bei der unüberschaubaren Anzahl von Nachrichten führt selbst eine geringe Fehlerquote zu unzähligen Falschmeldungen, die die Zahl der richtigen Meldungen bei weitem übersteigen können. Selbst bei einer Trefferquote von 99 % würde dies bedeuten, dass von den 100 Milliarden Nachrichten, die täglich allein über Whatsapp verschickt werden, 1 Milliarde (d. h. 1.000.000.000) falsch positive Meldungen überprüft werden müssten. Und das jeden Tag und nur auf einer einzigen Plattform. Der “menschliche Überprüfungsaufwand” für die Strafverfolgungsbehörden wäre immens, während der Rückstau und die Überlastung der Ressourcen bereits gegen sie arbeiten.

Unabhängig davon hat eine FOI-Anfrage des ehemaligen Europaabgeordneten Felix Reda die Tatsache aufgedeckt, dass diese Behauptungen über die Genauigkeit von der Industrie stammen – von denjenigen, die ein persönliches Interesse an diesen Behauptungen haben, weil sie Ihnen die Erkennungstechnologie verkaufen wollen (Thorn, Microsoft). Sie weigern sich, ihre Technologie einer unabhängigen Prüfung zu unterziehen, und wir sollten ihre Behauptungen nicht für bare Münze nehmen.

Weitere entlarvten Mythen und Argumentationshilfen hat D64 Zentrum für Digitalen Fortschritt zusammengestellt und kann man hier finden.

Weiterführende Informationen und Argumente gegen die Nachrichten- und Chatkontrolle

Massenüberwachung ist der falsche Weg im Kampf gegen “Kinderpornografie” und sexuell ausbeutende Darstellungen

- Das Scannen privater Nachrichten und Chats dämmt die Verbreitung ausbeutender Darstellungen nicht ein. Facebook beispielsweise praktiziert die Chatkontrolle seit Jahren und die Zahl der “Treffermeldungen” und automatisierten Strafanzeigen steigt von Jahr zu Jahr an auf zuletzt 22 Millionen im Jahr 2021.

- Die verpflichtende Chatkontrolle trifft die Täter, die Kindesmissbrauch aufnehmen und weitergeben, nicht. Missbrauchstäter tauschen ihr Material nicht über kommerzielle E-Mail-, Messenger- oder Chatdienste, sondern organisieren sich über selbst betriebene geheime Foren, ohne Scanner zu installieren. Bilder und Videos laden Missbrauchstäter außerdem typischerweise als verschlüsselte Archive hoch und teilen nur die Links und Passwörter. Chatkontrolle-Algorithmen erkennen weder verschlüsselte Archive noch Links wieder.

- Der richtige Weg wäre die Löschung bekannter Speicherorte ausbeutender Darstellungen im Netz. Weder Bundeskriminalamt noch Europol melden aber bekanntes Missbrauchsmaterial den Speicherdiensten.

- Chatkontrolle schadet der Verfolgung von Kindesmissbrauch, weil sie Ermittler millionenfach mit Computermeldungen überlastet, die zum Großteil strafrechtlich irrelevant sind.

Nachrichten- und Chatkontrolle schadet allen

- Alle Bürgerinnen und Bürger werden ohne Anlass unter Verdacht gestellt, Straftaten zu begehen. Die Text- und Bilderkennungsfilter werten unterschiedslos alle Nachrichten aus – unabhängig davon, ob ein konkreter Verdacht vorliegt oder nicht. Kein Richter muss dieser Durchsuchung zustimmen – ganz im Gegensatz zur analogen Welt, in der das Briefgeheimnis und damit die Vertraulichkeit der schriftlichen Kommunikation gewährleistet ist. Laut der Rechtsprechung des Europäischen Gerichtshofes ist eine permanente und verdachtslose automatische Auswertung privater Kommunikation grundrechtswidrig (Rechtssache C-511/18, Abs. 192). Die EU will die Gesetze trotzdem verabschieden. Sie vor Gericht zu stoppen kann Jahre dauern. Deswegen müssen die Gesetze bereits jetzt verhindert werden!

- Die Vertraulichkeit privater Kommunikation wird nachhaltig zerstört. Nutzerinnen und Nutzer von Messenger-Diensten und E-Mail müssen davon ausgehen, dass alle ihre Nachrichten künftig in Echtzeit mitgelesen und ausgewertet werden. Sensible Bild- und Textinhalte können an unbekannte Personen weltweit vollautomatisiert weitergeleitet werden und in falsche Hände geraten. Es sind bereits Fälle bekannt geworden, in denen die Mitarbeiter von US-Behördenabgefangene Nacktbilder von Nutzer*innen in Umlauf gebracht haben. Auch Konzernmitarbeiter haben bereits Kinderdaten missbraucht.

- Die Chatkontrolle zeigt Tausende zu Unrecht an. Nach Angaben der Schweizer Bundespolizei sind 80% der maschinell angezeigten Inhalte nicht strafbar, etwa Urlaubsfotos am Strand mit nackten Kindern. Auch in Irland wurden nur 20% der im Jahr 2020 eingegangenen NCMEC-Meldungen als tatsächliche “Kinderpornografie” (“CSAM”) bestätigt. In Deutschland liegt der prozentuale Anteil der Meldungen, die letztlich in Ermittlungsverfahren münden, über die Jahre relativ konstant im einstelligen Bereich (unter 10%). Größtenteils werden Unschuldige verdächtigt und teils intime Nacktfotos oder Chats offenbart.

- Sicher verschlüsselte Kommunikation ist in Gefahr. Denn verschlüsselte Nachrichten können bisher nicht von den Algorithmen erfasst werden. Um die Chatkontrolle für jede Online-Kommunikation zu ermöglichen, müssen Hintertüren eingebaut werden. Sobald das geschieht, kann diese Sicherheitslücke von jeder und jedem, der oder die die technischen Mittel dazu hat, ausgenutzt werden. Private Kommunikation, aber auch Geschäftsgeheimnisse und sensible Regierungsinformationen, wären Angriffen ab dann schutzlos ausgesetzt. Sichere Verschlüsselung schützt Minderheiten, LGBTQI-Personen, Demokratieaktivisten, Journalisten usw.

- Strafverfolgung wird privatisiert. Denn in Zukunft entscheiden die Algorithmen von Unternehmen wie Facebook, Google und Microsoft, welche Inhalte als verdächtig eingestuft werden und welche nicht. Dabei geht es nicht nur um Bilder, sondern auch bestimmte Wort-Kombinationen, die den Chatfiltern verdächtig erscheinen. Eine Transparenzpflicht über die Algorithmen ist nicht vorgesehen. In einem Rechtsstaat gehört die Ermittlung von Straftaten aber in die Hände unabhängiger Beamter unter gerichtlicher Aufsicht.

- Die Chatkontrolle ist ein Dammbruch. Die Technologie zum automatischen Mitlesen privater online-Kommunikation ist gefährlich. Denn sie kann spielend leicht auch für andere Zwecke entfremdet werden. In autoritären Staaten werden solche Filter zur Verfolgung und Inhaftierung unliebsamer Regierungsgegner*innen verwendet. Für die Algorithmen macht es keinen Unterschied, ob nach Kindesmissbrauch, nach Urheberrechtsverstößen, Drogenmissbrauch oder unliebsamen Meinungsäußerungen gesucht wird. Ist die Technik erst einmal flächendeckend etabliert, gibt es kein Zurück.

Warum die Nachrichten- und Chatkontrolle Kindern und Missbrauchsopfern besonders schadet

Die EU-Kommission argumentiert, dass die Chatkontrolle die Strafverfolgung von Kindesmissbrauch erleichtern soll. Das ist jedoch selbst unter Betroffenen von Missbrauch umstritten. Tatsächlich fügt das Vorhaben Opfern sexuellen Missbrauchs sowie Kindern und Jugendlichen im Allgemeinen am meisten Schaden zu:

- Schutzräume werden zerstört. Gerade Betroffene sexualisierter Gewalt sind auf die Möglichkeit angewiesen, sicher und vertraulich kommunizieren zu können. Räume zum sicheren Austausch untereinander oder etwa mit Therapeut*innen und Anwält*innen helfen Betroffenen bei der Verarbeitung und dem Umgang mit ihren Erfahrungen. Diese sicheren Räume werden ihnen nun durch die Einführung von Echtzeitüberwachung genommen. Das kann Opfer davon abhalten, Hilfe und Unterstützung zu suchen.

- Selbst aufgenommene Nacktaufnahmen von Minderjährigen (Sexting) geraten in die Hände von Unternehmensmitarbeitern und Polizei, wo sie nicht hingehören und nicht sicher sind.

- Jugendliche werden überproportional kriminalisiert. Laut Kriminalstatistik sind fast 40% aller wegen Kinderpornografie von der Polizei verfolgten Personen Minderjährige.

- Die Chatkontrollen dämmen den Austausch illegalen Materials nicht ein, sondern erschweren die Strafverfolgung von Kindesmissbrauch zusätzlich. Denn sie verdrängen kriminelle Täter in den Untergrund, wo sie kaum noch zu überwachen sind. Ermittler berichten, sie seien derart ausgelastet mit der Auswertung der NCMEC-Meldungen, dass für die Mitarbeit an Aufdeckung großer Kinderpornografie-Ringe keine Kapazitäten mehr vorhanden seien. Auch in offenen Kanälen haben die Kontrollen die Menge der weitergegebenen Darstellungen nicht eingedämmt, wie die von Jahr zu Jahr steigenden Zahlen an Verdachtsmeldungen belegen.

Video: Chatkontrolle – Es ist noch nicht vorbei. Vortrag auf dem Chaos Computer Congress am 29.12.2023 mit Patrick Breyer, khaleesi (CCC) und Ulrich Kelber (Bundesdatenschutzbeauftragter)

Alternativen zur Chatkontrolle

Ausbau der Kapazitäten der Strafverfolgung

Momentan sind die Kapazitäten der Strafverfolger so unzureichend, dass oft Monate und Jahre vergehen, bis Hinweisen nachgegangen und Daten ausgewertet sind. Bekanntes Material wird häufig lange weder gesichtet noch gelöscht. Die Hintermänner des Missbrauchs tauschen ihr Material nicht über Facebook und ähnliche Kanäle aus, sondern im Darknet. Um Produzenten von Missbrauchsmaterial aufzuspüren, muss verdeckte Polizeiarbeit stattfinden, statt die knappen Kapazitäten auf Massenverfahren zu verschwenden. Es ist außerdem unerlässlich, die verantwortlichen Ermittlungseinheiten personell und finanziell aufzustocken, damit gründliche und nachhaltige Ermittlungen über längere Zeiträume hinweg möglich sind. Auch müssen verlässliche Standards/Richtlinien für die polizeiliche Bearbeitung von Fällen sexuellen Missbrauchs erarbeitet und eingehalten werden.

Nicht nur Symptome bekämpfen, sondern die Ursache

Anstelle untauglicher Versuche Missbrauchsdarstellungen nachträglich wieder „einfangen“ zu wollen, muss alles daran gesetzt werden, dass solche Aufnahmen niemals entstehen und dass Missbrauch verhindert und gestoppt wird. Präventionskonzepte und Schulungen in Betreuungseinrichtungen spielen eine Schlüsselrolle, weil die allermeisten Missbrauchsfälle nie auch nur bekannt werden. Es fehlt auch den Opferschutzorganisationen meist eine stabile Finanzierung.

Schnelle und einfach verfügbare Hilfe für (potenzielle) Opfer

- Verpflichtende Meldemechanismen bei Online-Diensten: Um die wirkungsvolle Prävention von Online-Missbrauch und insbesondere Grooming zu erreichen, sollten die Online-Dienste verpflichtet werden, Hinweis- und Meldefunktionen auf den Plattformen prominent zu platzieren. Wenn sich das Angebot an Jugendliche oder Kinder richtet und/oder von Jugendlichen und Kindern genutzt wird, sollten Anbieter auch verpflichtet sein, sie über die Risiken des Online-Groomings zu informieren.

- Hotlines und Beratungsstellen: Viele nationale Hotlines, die sich mit Fällen von gemeldetem Missbrauchsmaterial befassen, haben mit finanziellen Problemen zu kämpfen. Hier muss unbedingt sicher gestellt werden, dass ausreichend Kapazität besteht, gemeldeten Fällen nachzugehen.

Verbesserung der Medienkompetenz

Die frühe Vermittlung von digitaler Kompetenz ist ein wesentlicher Bestandteil zum Schutz von Kindern und Jugendlichen online. Die Kinder selbst müssen über das Wissen und die Werkzeuge verfügen, sich im Internet sicher zu bewegen. Sie müssen darüber informiert werden, dass auch online Gefahren lauern und lernen, die Muster von Grooming zu erkennen und zu hinterfragen. Hierzu wären zum Beispiel gezielte Angebote in Schulen und Ausbildungsstätten sinnvoll, in denen geschultes Personal Wissen vermittelt und Diskussionen leitet.

Kinder müssen lernen, sich zu äußern, zu reagieren und Anzeige zu erstatten, selbst wenn der Missbrauch aus ihrem Vertrauensbereich kommt (d. h. von nahestehenden Personen oder anderen Personen, die sie kennen und denen sie vertrauen), was häufig der Fall ist. Sie müssen auch Zugang zu sicheren, zugänglichen und altersgerechten Kanälen haben, um Missbrauch ohne Angst melden zu können.

Dokumente zur Chatkontrolle 2.0

EP legislative observatory (Englisch) (regelmäßig aktualisiert)

Trilog

- 4-Spalten-Dokument mit Änderungsmarkierungen (9. Dezember 2025)

- 4-Spalten-Dokument zur Gegenüberstellung der Verhandlungsmandate (5. Dezember 2025)

Europäisches Parlament

- Verhandlungsmandat (14.11.2023)

- Änderungsanträge 277 – 544 (30. Mai 2023)

- Änderungsanträge 545 – 953 (30. Mai 2023)

- Änderungsanträge 954 – 1332 (30. Mai 2023)

- Änderungsanträge 1333 – 1718 (30. Mai 2023)

- Änderungsanträge 1719 – 1909 (30. Mai 2023)

- Berichtsentwurf des Berichterstatters (25. April 2023)

- Ergänzende Folgenabschätzung des wissenschaftlichen Dienstes des Europäischen Parlaments (Englisch) (April 2023)

- Briefing: Commission proposal on preventing and combating child sexual abuse: The Commission’s engagement with stakeholders (15. November 2023)

Rat der Europäischen Union (Ministerrat)

- Ratsdokumente (regelmäßig aktualisiert)

- Abstimmungsergebnis Ratsmandat – siehe Nr. 63 (28. November 2025, 16236/25)

- Kompromissvorschläge der dänischen Ratspräsidentschaft (13. November 2025, 15318/25)

- Erklärung der dänischen Ratspräsidentschaft (12. November 2025, 15474/25)

- Präsentation der dänischen Ratspräsidentschaft (10. November 2025, 15166/25)

- Kompromissvorschläge der dänischen Ratspräsidentschaft (6. November 2025, 14092/25)

- Diskussionspapier der dänischen Ratspräsidentschaft (30. Oktober 2025, 14032/25)

- Kompromissvorschläge der dänischen Ratspräsidentschaft (3. Oktober 2025, 13095/25)

- Kompromissvorschläge der dänischen Ratspräsidentschaft (24. Juli 2025, 11596/25)

- Kompromissvorschläge der dänischen Ratspräsidentschaft (1. Juli 2025, 10131/25)

- Fortschrittsbericht (2. Juni 2025, 9277/25)

- Informationsvermerk der Präsidentschaft (1. Juli 2025, WK 9150/25 INIT)

- Kompromissvorschläge der polnischen Ratspräsidentschaft (13. Mai 2025, 8621/25)

- Unterrichtung Sitzung der Innenreferenten am 29. April 2025

- Unterrichtung Sitzung der RAG Strafverfolgung am 8. April 2025

- Kompromissvorschläge der polnischen Ratspräsidentschaft (4. April 2025, 7080/25)

- Stellungnahmen der Mitgliedsstaaten (20. März 2025, WK 3471/2025 INIT)

- Unterrichtung Sitzung der RAG Strafverfolgung am 11. März 2025

- Kompromissvorschläge der polnischen Ratspräsidentschaft (4. März 2025, 6475/25)

- Unterrichtung Sitzung der RAG Strafverfolgung am 5. Februar 2025

- Kompromissvorschläge der polnischen Ratspräsidentschaft (28. Januar 2025, 5352/25)

- Abstimmungserklärungen von Österreich und Slowenien

- Kompromissvorschlag/Gesetzentwurf der Ratspräsidentschaft (3. Dezember 2024, 16547/24)

- Kompromissvorschlag/Gesetzentwurf der Ratspräsidentschaft (29. November 2024, 16329/24)

- Kompromissvorschlag/Gesetzentwurf der Ratspräsidentschaft (ST 13726/24 REV 1) vom 7. Oktober 2024

- Überarbeiteter Kompromissvorschlag/Gesetzentwurf der Ratspräsidentschaft (13726/24) vom 24. September 2024

- Unterrichtung Sitzung des AStV am 23. September 2024

- Kompromissvorschlag/Gesetzentwurf der Ratspräsidentschaft (12406/24) vom 9. September 2024

- Skizze eines Kompromissvorschlags der Ratspräsidentschaft (ST 12319/24) vom 29. August 2024

- Erläuterungen der Ratspräsidentschaft zum Vorschlag (WK 8634/2024 INIT) vom 14. Juni 2024

- Kompromissvorschlag der Ratspräsidentschaft (ST-11277/24) vom 14. Juni 2024

- Fortschrittsbericht im Rat (ST-10666-2024-INIT) vom 7. Juni 2024

- Unterrichtung Sitzung der RAG Strafverfolgung am 4. Juni 2024

- Kompromissvorschlag der Ratspräsidentschaft (ST-9093-2024-INIT) vom 28. Mai 2024

- Unterrichtung Sitzung der RAG Strafverfolgung am 24. Mai 2024

- Präsentation der Ratspräsidentschaft vom 8. Mai 2024 (WK 6697/2024 INIT)

- Unterrichtung Sitzung der RAG Strafverfolgung am 8. Mai 2024

- Unterrichtung Sitzung der RAG Strafverfolgung am 15. April 2024

- Aktualisierte Kriterien zur Risikobewertung (WK 3036/2024 Rev. 2) vom 10. April 2024

- Kompromissvorschlag der Ratspräsidentschaft (ST-8579-2024-INIT) vom 09. April 2024

- Unterrichtung Sitzung der RAG Strafverfolgung – Polizei am 3. April 2024

- Kompromissvorschlag der Ratspräsidentschaft (ST-8019-2024-INIT) mit aktualisierten Kriterien zur Risikobewertung (WK 3036/2024 Rev. 1) vom 27.03.2024

- Unterrichtung Sitzung der RAG Strafverfolgung – Polizei am 19. März 2024

- Kompromissvorschlag der Ratspräsidentschaft vom 13. März 2024 (ST-7462-2024-INIT)

- Präsentation der Ratspräsidentschaft vom 01. März 2024 (WK 3413/2024 INIT)

- Unterrichtung Sitzung der RAG Strafverfolgung – Polizei am 1. März 2024

- Kriterien zur Risikobewertung der Ratspräsidentschaft vom 26. Februar 2024 (WK 3036/2024 INIT)

- Kompromissvorschlag der Ratspräsidentschaft vom 22. Febraur 2024 (ST-6850-2024-INIT)

- Unterrichtung Sitzung der RAG Strafverfolgung am 6. Dezember 2023

- Unterrichtung Sitzung der RAG Strafverfolgung am 1. Dezember 2023

- Weisung zum AStV-2 am 18. Oktober 2023

- Unterrichtung Sitzung des AStV 2 am 13. Oktober 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 10. Oktober 2023

- Unterrichtung Sitzung der RAG Strafverfolgung am 14. September 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 8. September 2023

- Unterrichtung der RAG Strafverfolgung vom 26. Juli 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 16. Juli 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 08. Juni 2023

- Öffentliche Sitzung des Rates Justiz und Inneres am mit Stellungnahmen der schwedischen Ratspräsidentschaft und Kommissarin Ylva Johansson am 08. Juni 2023

- Unterrichtung Sitzung der RAG Strafverfolgung am 12. Mai 2023

- Unterrichtung Sitzung der RAG Strafverfolgung am 27./28. April 2023

- Gemeinsamer Standpunkt der gleichgesinnten Gruppe der Mitgliedstaaten (Englisch) (27. April 2023)

- Unterrichtung Sitzung der RAG Strafverfolgung am 13. April 2023

- Stellungnahmen EU-Regierungen zu Verschlüsselung (WK 10235/2022 ADD 10 REV 2 – 12. April 2023)

- Meinungsbild im Rat zu Artikel 12-15 (12. April 2023)

- Unterrichtung Sitzung der RAG Strafverfolgung am 29. März 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 23. März 2023

- Unterrichtung Sitzung der RAG Strafverfolgung am 16. März 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 15. März 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 8. März 2023

- Unterrichtung Sitzung der RAG Strafverfolgung – Polizei am 24. Februar 2023

- Kompromissvorschläge der Ratspräsidentschaft vom 16. Februar 2023

- Unterrichtung Sitzung der RAG Strafverfolgung (LEWP-P) am 19./20.01.2023

- Fortschrittsbericht des Rates (24. November 2022)

- Unterrichtung Sitzung der RAG Strafverfolgung (LEWP-P) am 24. November 2022

- Unterrichtung Sitzung der RAG Strafverfolgung (LEWP-P) am 3. November 2022

- Unterrichtung Sitzung der RAG Strafverfolgung (LEWP) am 20. Juli 2022

- Unterrichtung Sitzung der RAG Strafverfolgung – Polizei (LEWP-Police) am 22. Juni 2022

Europäische Kommission

- Non-paper Comments of the services of the Commission on some elements of the Draft Final Complementary Impact Assessment (Englisch) (17. Mai 2023)

- Briefing für Kommisarin Ylva Johansson für ein Treffen mit einen französischen Minister (27. September 2022)

- Öffentliche Konsultation (Englisch) (geschlossen am 12. September 2022), siehe auch diese Auswertung

- Non-paper Balancing children’s rights with user rights (Englisch) (16. Mai 2022)

- Verordnungsentwurf zur verpflichtenden Chatkontrolle und Folgenabschätzung (11. Mai 2022)

- Zweite Stellungnahme des Ausschuss für Regulierungskontrolle (Englisch)(28. März 2022)

- Qualitätscheckliste für Stellungnahme des Ausschusses für Regierungskontrolle (Englisch) (06. November 2021)

- Geleakte Stellungnahme der Kommission löst Bestürzung aus über Massenüberwachung der privaten Kommunikation (23. März 2022)

- Antwort der EU Kommission auf einen parteiübergreifenden Brief gegen die geplante verpflichtende Chatkontrolle (9. März 2022)

- Stellungnahme Ausschuss für Regulierungskontrolle (Englisch) (15. Februar 2022)

- Technische Lösungen zur Durchleuchtung Ende-zu-Ende-verschlüsselter Kommunikation (September 2020)

Gutachten & Stellungnahmen

- Statement des Europäischen Datenschutzausschusses (13. Februar 2024)

- Rechtsgutachten des ehemaligen EuGH-Richters Christopher Vajda KC (19. Oktober 2023)

- Gutachten des Juristischen Dienstes des Ministerrats (26. April 2023)

- Stellungnahme des Bundesregierung (April 2023)

- Ergebnisbericht Erfolgsaussichten des Kommissionsvorschlags Universität Groningen (Englisch) (25.01.2021)

- Zusammenfassung der Stellungnahme des Kinderschutzbundes Bundesverband e.V. zur Öffentlichen Anhörung des Ausschusses für Digitales zur “Chatkontrolle” (1. März 2023)

- Zusammenfassung der Stellungnahme des Bundesbeauftragten für den Datenschutz und die Informationsfreiheit zur Öffentlichen Anhörung des Ausschusses für Digitales zur “Chatkontrolle” (1. März 2023)

- Zusammenfassung der Stellungnahme des Generalstaatsanwaltschaft Köln, Zentral- und Ansprechstelle Cybercrime (ZAC) zu der öffentlichen Anhörung des Ausschusses für Digitales des Deutschen Bundestags zur „Chatkontrolle”

- Briefing des Wissenschaftlicher Dienst des Europäischen Parlaments (Dezember 2022)

- Gutachten des wissenschaftlichen Dienstes des Bundestags zur Chatkontrolle (14. Oktober 2022)

- Stellungnahme Europäischer Wirtschafts- und Sozialausschuss (13. September 2022)

- Gemeinsame Stellungnahme EDPB und EDPS (Englisch) (28. Juli 2022)

- Stellungnahme Ausschuss für Regulierungskontrolle (Englisch) (15. Februar 2022)

- Antworten von Europol zu den Ermittlungsstatistiken in Bezug auf kinderpornografisches Material online (Englisch) (28. April 2021)

Umfragen

- Umfrage zur Chatkontrolle: 80% der Jugendlichen lehnen Chatkontrolle ab, 40% verschicken selbst Nacktfotos (3. März 2023)

- Umfrage: 72% der Bürger*innen gegen EU-Pläne zur automatisierten Nachrichten- und Chatkontrolle mit Strafanzeigeautomatik (28. April 2021)

Dokumente zur freiwilligen Chatkontrolle 1.0

Laufendes Gesetzgebungsverfahren zur Verlängerung der Chatkontrolle 1.0:

- EP legislative observatory (Englisch): regelmäßig aktualisierte Informationen zur Verlängerung der Chatkontrolle 1.0

- Dokumentenregister des EU-Rats: neueste Ratsdokumente zur Verlängerung der Chatkontrolle 1.0

- Änderungsanträge zum Mandatsentwurf der Berichterstatterin des EU-Parlaments (10. Februar 2026)

- Mandatsentwurf der Berichterstatterin des EU-Parlaments (5. Februar 2026) und mein Kommentar

- Verhandlungsmandat des EU-Rats (29. Januar 2026)

- Vorschlag der EU-Kommission zur Verlängerung der Ausnahmeverordnung zur Chatkontrolle 1.0 um weitere zwei Jahre (19. Dezember 2025)

- Bericht der Kommission an das Europäische Parlament und den Rat über die Umsetzung der ePrivacy-Ausnahmeregelung zur freiwilligen Chatkontrolle sowie meine Anmerkungen dazu (27. November 2025)

Archiv:

- Änderungsanträge zum Verordnungsentwurf zur Verlängerung der freiwilligen Chatkontrolle (Januar 2024)

- Verordnungsentwurf zur Verlängerung der freiwilligen Chatkontrolle (Januar 2024)

- Bericht der Kommission an das Europäische Parlament und den Rat über die Implementierung der ePrivacy-Ausnahmeverordnung zur freiwilligen Chatkontrolle (Januar 2024)

- 2021 Berichte zur freiwilligen Chatkontrolle von Meta, Twitter und Google

- Rechtsgutachten der ehemaligen EuGH-Richterin Ninon Colneric zur Vereinbarkeit der Chatkontrolle mit der Rechtssprechung des EuGH (Englisch) (März 2021)

- Gutachten des Wissenschaftlichen Dienstes des Europaparlaments (EPRS) (Englisch) (05. Februar 2021)

- Änderungsanträge zum Verordnungsentwurf zur freiwilligen Chatkontrolle (26.11.2020)

- Antworten der EU-Kommission auf Fragen der Parlamentsabgeordneten (27. Oktober 2020)

- Antworten der EU-Kommission auf Fragen der Parlamentsabgeordneten (28. September 2020)

- Technische Lösungen zur Durchleuchtung Ende-zu-Ende-verschlüsselter Kommunikation (September 2020)

Kritische Stellungnahmen und Hintergrundartikel zur Nachrichtendurchleuchtung

- Bund Deutscher Kriminalbeamte: “Eine Ausweitung dieser Systeme würde die Behörden weiter überlasten, ohne die Erfolgsquote zu verbessern.” (10.10.2025)

- Rainer Wendt, Vorsitzender der Deutschen Polizeigewerkschaft: „Chatkontrollen, durch wen auch immer, sind das Ende von Privatheit, Meinungsfreiheit und Demokratie. Als Gewerkschafter bin ich auf vertrauliche Kommunikation, beispielsweise mit Journalisten, Kollegen oder Politikern angewiesen.“ (08.10.2025)

- Dutzende führender europäischer Technologieunternehmen und European Digital SME Alliance: “Digitale Souveränität kann nicht erreicht werden, wenn Europa die Sicherheit und Integrität seiner eigenen Unternehmen untergräbt, indem es clientseitiges Scannen oder andere ähnliche Tools oder Methoden vorschreibt, die zum Scannen verschlüsselter Daten entwickelt wurden. Technologieexperten haben erneut bestätigt, dass dies nicht möglich ist, ohne die Verschlüsselung zu schwächen oder zu untergraben.” (07.10.2025)

- Zivilgesellschaft und Gewerkschaftsverbände: “European Commission: uphold privacy, security and free expression by withdrawing new law” (8. Juni 2022)

- Jeremy Malcolm: “How the War against Child Abuse Material was lost” (19. August 2020)

“Wir müssen bessere Lösungen für die Menschen schaffen, die sich dazu hingezogen fühlen.”

- UN-Ausschuss für die Rechte des Kindes, General comment No. 25 (2021):

“Jede digitale Überwachung von Kindern und jede damit verbundene automatisierte Verarbeitung personenbezogener Daten sollte das Recht des Kindes auf Privatsphäre respektieren und nicht routinemäßig, wahllos oder ohne das Wissen des Kindes durchgeführt werden…”

(eigene Übersetzung)

- European Digital Rights (EDRi): “Is surveilling children really protecting them? Our concerns on the interim CSAM regulation” (24. September 2020)

“[D]die Verordnung überträgt privaten Unternehmen die Verantwortung für eine Angelegenheit, die von öffentlichen Behörden erledigt werden sollte.”

- Civil Society Organisations: “Open Letter: Civil society views on defending privacy while preventing criminal acts” (27. Oktober 2020)

“Wir schlagen vor, dass die Kommission nicht-technischen Maßnahmen und der schnelleren Entfernung von anstößigen Websites den Vorrang vor clientseitiger Durchsuchung von Nachrichteninhalten einräumt“

- Europäischer Datenschutzbeauftragter: “Opinion on the proposal for temporary derogations from Directive 2002/58/EC for the purpose of combatting child sexual abuse online” (10. November 2020)

“Die in dem Vorschlag vorgesehenen Maßnahmen würden einen Eingriff in die Grundrechte auf Achtung des Privatlebens und den Datenschutz aller Nutzer sehr beliebter elektronischer Kommunikationsdienste, wie Instant-Messaging-Plattformen und -Anwendungen, darstellen. Die Vertraulichkeit der Kommunikation ist ein Eckpfeiler der Grundrechte auf Achtung des Privat- und Familienlebens. Selbst freiwillige Maßnahmen privater Unternehmen stellen einen Eingriff in diese Rechte dar, wenn die Maßnahmen die Überwachung und Analyse des Inhalts der Kommunikation und die Verarbeitung personenbezogener Daten beinhalten.”

- Gesellschaft für Informatik: Gegen Überwachung digitaler Kommunikation in Europa (08. November 2021)

“Mit der geplanten Regelung verstößt die EU-Kommission gegen die Grundrechte der Bürgerinnen und Bürger, die in der Europäische Grundrechtecharta (GRCh) garantiert werden: insbesondere Artikel 7 (Achtung des Privat- und Familienlebens), Artikel 8 (Schutz personenbezogener Daten) und Artikel 11 (Meinungsäußerungsfreiheit und Informationsfreiheit) garantieren grundsätzlich vertrauliche Kommunikation. Eine derartige Überwachung legt auch die verschlüsselte und unverschlüsselte Kommunikation von Unternehmen, Behörden offen – ebenso von Medienschaffenden und ihren Informantinnen und Informanten.”

- Alexander Hanff (Victim of Child Abuse and Privacy Activist): “Why I don’t support privacy invasive measures to tackle child abuse.” (11. November 2020)

“Als Missbrauchsüberlebender bin ich (und Millionen anderer Überlebender auf der ganzen Welt) auf vertrauliche Kommunikation angewiesen, um Unterstützung zu finden und die Verbrechen gegen uns zu melden – unsere Rechte auf Privatsphäre und Vertraulichkeit zu beschneiden, bedeutet, uns weiteren Verletzungen auszusetzen, und offen gesagt, haben wir genug gelitten. […] es spielt keine Rolle, welche Schritte wir unternehmen, um Täter zu finden, es spielt keine Rolle, wie viele Freiheiten oder verfassungsmäßige Rechte wir zerstören, um diese Agenda zu erfüllen – es wird Kinder NICHT vor Missbrauch schützen, es wird den Missbrauch einfach weiter in den Untergrund treiben, es immer schwieriger machen, ihn zu entdecken und letztendlich dazu führen, dass mehr Kinder als Endergebnis missbraucht werden.”

- AccessNow: “The fundamental rights concerns at the heart of new EU online content rules” (19. November 2020)

“In der Praxis bedeutet dies, dass private Unternehmen mit einer Angelegenheit betraut würden, die eigentlich von öffentlichen Behörden behandelt werden sollte”